Tecnología española, al servicio de la productividad y eficiencia. Grupo Tempo le presenta a Grupo Vermon, su socio en innovación y tecnología.

Grupo Tempo desarrolla el plan de igualdad para un Centro Educativo en Madrid.

10/12/2020

Eventos el “RE-ENCUENTRO CON MI EQUIPO”

08/03/2021

Grupo Vermon, Empresa española data experts. Con una propuesta de valor única para que su proceso de transformación e innovación sea un éxito. La Innovación está en el ADN de Grupo Vermon. Con dos aplicaciones fundamentales para cualquier industria y empresa.

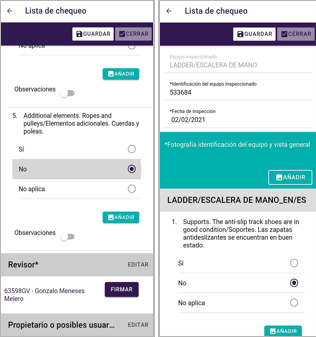

Risk Control, aplicación Móvil y Web para Control Operacional ( por ej. en prevención de riesgos laborales) y MAS4WIN como sistema inteligente predictivo de causas de anomalías en diferentes industrias, y que permite planificar y desplegar las operaciones de reparación y mantenimiento

Risk control es una app capaz de gestionar cualquier tarea repetitiva de las compañías en las que se puedan aplicar formularios o “listas de tareas”, que requieran de planificación, seguimiento y control de los mismos. Se ha desarrollado para Siemens Gamesa

El usuario elige el terminal que más le conviene.

- Puede utilizarlo desde móviles y tablets, lo que le permitirá consultar toda la información desde cualquier lugar y en el momento que necesite.

- Completamente multiplataforma puede utilizarse en dispositivos Android, próximamente también en iOS.

- Acceso en cualquier momento y desde cualquier lugar a través de un dispositivo móvil.

- El uso de las funciones de seguridad avanzadas de Amazon Cognito ayuda a proteger las cuentas de usuarios, la aplicación y la experiencia de los usuarios.

- Amazon Cognito cumple los requisitos de seguridad y conformidad HIPAA, PCI DSS, SOC, ISO/IEC 27001, ISO/IEC 27017, ISO/IEC 27018 e ISO 9001.

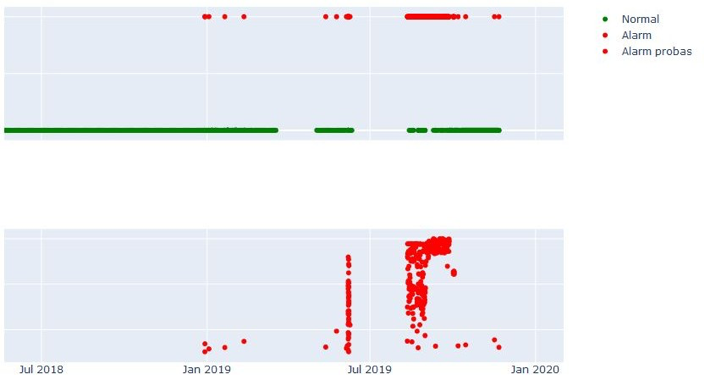

Mas4Win como sistema inteligente predictivo de causas de anomalías en diferentes industrias, y que permite planificar y desplegar las operaciones de reparación y mantenimiento.

Estimación vida útil de componentes, Soporte al sistema GMAO de operaciones y mantenimiento, Trazabilidad de mapas de abastecimiento, predicción de repuestos, tendencias de cambios a nivel activo-componente,.

Con aplicabilidad por ej. en parques eólicos, sistemas de mantenimiento, industria ferroviaria y del transporte en general. En definitiva a todos los sistemas industriales que requieren de tareas de mantenimiento para controlar y tomar decisiones clave para la productividad en los valores óptimos aplicando inteligencia artificial al área de BI. Se ha desarrollado en un CDTI para un consorcio de varias empresas españolas

¿Quieres saber mas?. Pues ponte en contacto con nosotros rrrpp@grupotempo.com

Y como le decíamos al principio: Grupo Tempo le presenta a Grupo Vermon, su socio en innovación y tecnología. Empresa española data experts. Con una propuesta de valor única para que su proceso de transformación e innovación sea un éxito. La Innovación está en el ADN de Grupo Vermon.

Trabajamos con el cliente desde el inicio del concepto hasta la generación del producto final, con el máximo compromiso, para desarrollar un presente preparado para el futuro.

Con más de 15 años de experiencia en sectores tan diversos como el Ferroviario, Bancario, Salud y Bienestar, Energético, Medio Ambiente… tenemos la seguridad de ofrecer el mejor servicio con la máxima calidad.